El Parlamento Europeo ha aprobado un proyecto centrado en regular el uso de la Inteligencia Artificial (IA) dentro de la Unión Europea (UE). Esto marca el inicio de complejas negociaciones con los 27 países miembros del bloque.

La legislación, que recibió 499 votos a favor, 28 en contra y 93 abstenciones, clasificará la IA en función de su nivel de riesgo. Cuanto mayor sea el riesgo para los derechos o la salud de las personas, más obligaciones se impondrán a los sistemas tecnológicos.

Los planes iniciales de la UE para regular el uso de la IA se remontan a 2021, pero la aparición del ChatGPT puso de relieve el rápido desarrollo del sector, lo que dio urgencia a la cuestión.

Funcionarios de la UE han declarado que las negociaciones directas con los 27 países miembros comenzarán de inmediato, con el objetivo de alcanzar un acuerdo definitivo a finales de año.

Aunque se alcance este objetivo, la legislación no entrará en vigor hasta 2026. Como consecuencia, la UE también tendrá que negociar un marco temporal y voluntario con las empresas tecnológicas que desarrollen IA.

La mayoría de los miembros del Parlamento Europeo (PE) apoyaron la legislación, considerándola un hito.

Tarea normativa compleja

"¿Es el momento adecuado para que Europa regule la IA? Mi respuesta es un sí rotundo: es el momento adecuado debido al profundo impacto que está teniendo la IA", dijo el eurodiputado Dragos Tudorache durante el debate parlamentario del martes en Estrasburgo.

"Lo que podemos hacer aquí es crear confianza y seguridad jurídica para permitir que la IA se desarrolle positivamente", dijo la Vicepresidenta de la Comisión Europea, Margrethe Vestager.

La ley en estudio clasificará la IA en función del nivel de riesgo: cuanto mayor sea el riesgo para los derechos o la salud de las personas, más obligaciones se impondrán a los sistemas.

La lista de alto riesgo de la UE incluye la IA en infraestructuras críticas, educación, recursos humanos, orden público y gestión de la migración.

El Parlamento Europeo ha incorporado condiciones adicionales para una clasificación de alto riesgo, como el potencial para dañar la salud, la seguridad, los derechos fundamentales o el medio ambiente.

También existen requisitos distintos para los sistemas de IA generativa, como ChatGPT y DALL-E, que pueden crear texto, imágenes, código, audio y otros medios. Esto implica la obligación de informar a los usuarios de que el contenido ha sido generado por una máquina, no por un ser humano.

Brando Benifei, uno de los legisladores promotores de la iniciativa, instó a adoptar un "enfoque común" para abordar los riesgos de la IA. "Tenemos que comparar notas con legisladores de todo el mundo", afirmó.

Tudorache subrayó que la ley es necesaria "porque esperar a que las empresas se autorregulen no es suficiente para salvaguardar a nuestros ciudadanos."

Además, los legisladores proponen prohibir los sistemas de vigilancia biométrica, el reconocimiento de emociones y los sistemas de IA de vigilancia predictiva.

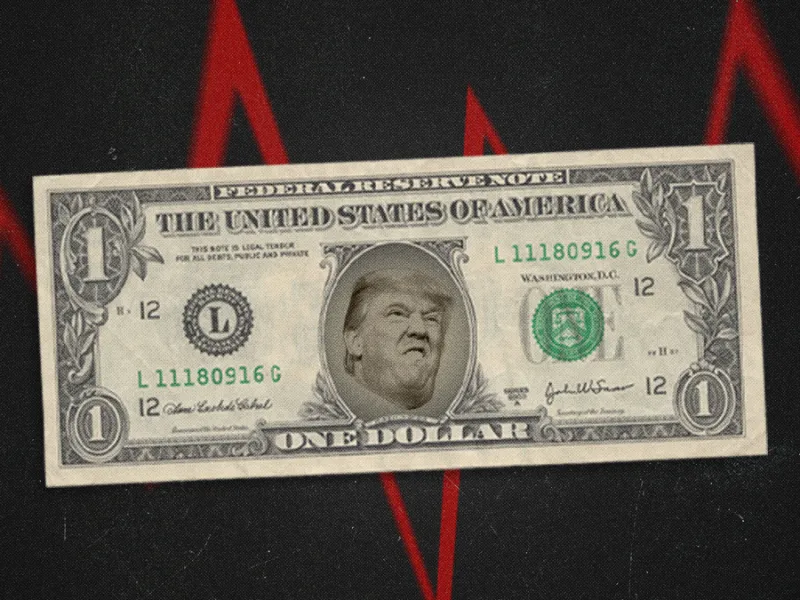

La proliferación de imágenes falsas en las redes sociales generadas por aplicaciones basadas en IA, como Midjourney, ha aumentado la preocupación por los riesgos para la manipulación de la opinión pública y la democracia.

Por este motivo, los científicos europeos han pedido una moratoria en el desarrollo de los sistemas más potentes hasta que estén mejor regulados por ley.